Algorithmes et Réseaux Sociaux : Neutres ou Discriminants ?

Découvrez comment les algorithmes de recommandation fonctionnent et s'ils reproduisent les biais humains et les injustices sociales sur les réseaux.

LES ALGORITHMES : NEUTRES OU DISCRIMINANTS ?

Analyse de la reproduction des injustices sociales et de l'invisibilisation des minorités sur les réseaux sociaux.

La promesse vs La réalité

Les réseaux sociaux promettent une voix à chacun. Pourtant, des systèmes informatiques décident en secret de ce qui est visible ou non. La question centrale : ces algorithmes reproduisent-ils les injustices humaines ?

Comment fonctionne l'algorithme ?

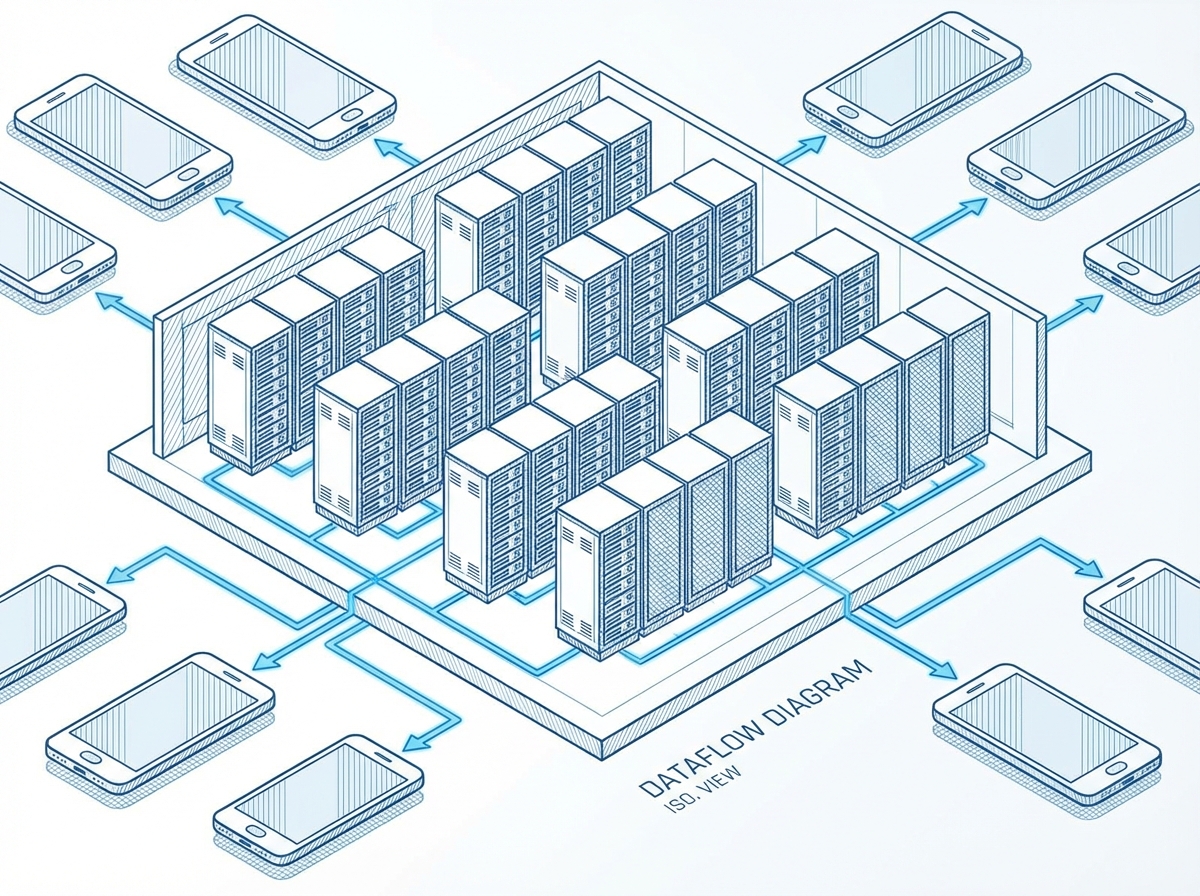

Big Data : Stockage massif de publications, interactions et profils.

Machine Learning : Le code n'est pas fixe, il apprend de nos comportements.

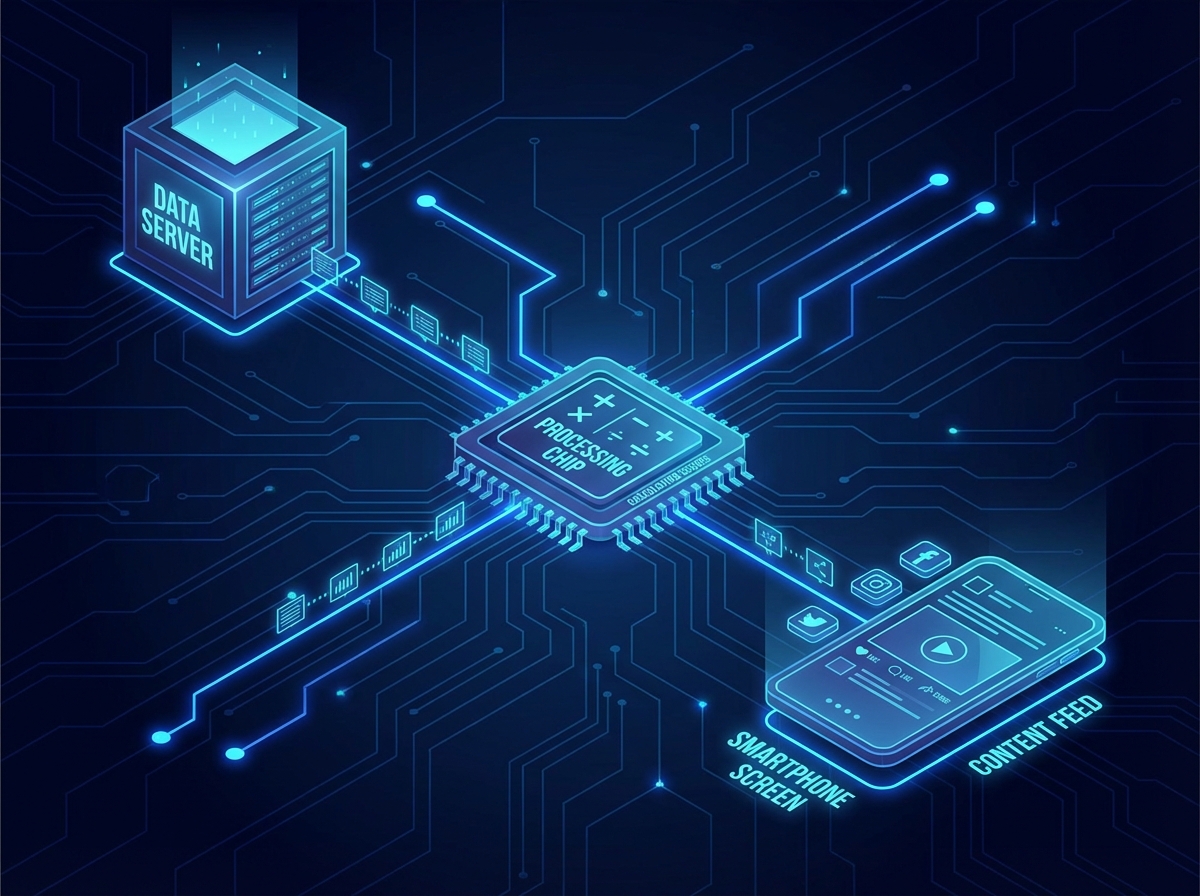

Cycle des recommandations

Un processus automatisé en quatre étapes pour transformer le Big Data en un flux captivant.

Collecte Massive

Agrégation de tout signal : posts, likes, commentaires, temps passé et métadonnées.

Calcul du Score

Chaque interaction a un poids. L'algorithme calcule la probabilité exacte d'engagement.

Filtrage & Ordre

Classement de milliers de contenus pour ne garder que les 'gagnants' mathématiques.

Affichage Personnalisé

Le flux final apparaît sur votre écran, conçu pour maximiser le temps de rétention.

Conclusion : Le score dicte la visibilité. L'algorithme optimise mathématiquement pour triompher de votre attention.

Le Score de Pertinence : Une mathématique de l'attention

L'algorithme attribue des points aux interactions pour décider du classement. Exemple de pondération utilisée pour maximiser le temps d'écran :

L'algorithme a-t-il des préjugés ?

Les données viennent des humains => Les humains ont des biais => L'algorithme apprend ces biais.

EXEMPLE CONCRET : La reconnaissance faciale entraînée sur un jeu de données à 80% caucasien devient 'analphabète' pour les autres visages.

Partie 1 — Ce que révèle la mécanique

L'algorithme n'est pas magique : c'est une suite d'instructions alimentée par le <b>Big Data</b>. Il stocke massivement vos posts, likes, commentaires, hashtags et analyse chaque détail de votre profil.

Grâce au Machine Learning, le code évolue seul en apprenant de vos comportements. Il attribue une valeur à chaque action pour filtrer le contenu :

Tout est basé sur des données humaines. La technologie n'est pas neutre : elle absorbe nos biais (racisme, sexisme, homophobie) et risque de les amplifier massivement.

Biais de reconnaissance faciale : Jeu de données 80% caucasien.

Score calculé sur les interactions

Classement par valeur prédictive

Visibilité optimisée = Temps max

Les systèmes qui se prétendent neutres peuvent reproduire l’oppression.

« Les systèmes qui se prétendent neutres peuvent reproduire l’oppression. »

Angela Davis

Partie 2 : L'impact sur la visibilité

Quand l'algorithme invisibilise

Moins de visibilité pour les contenus dénonçant les discriminations (racisme, sexisme).

Certains hashtags militants sont 'shadowbanned' (masqués sans avertissement).

Le revers de la médaille : La mobilisation

Malgré les biais, les réseaux restent des outils puissants pour les minorités.

#BlackLivesMatter

#MeToo

#Pride

« Il n’y a pas de révolution possible sans voix et sans visibilité. »

Thomas Sankara

Étude de Cas : X (Twitter) & le DSA

Le Digital Services Act (DSA - 2023) impose la transparence des algorithmes en Europe.

Révélations : Depuis le rachat par Elon Musk, des rapports indiquent une promotion disproportionnée de contenus d'extrême droite.

Conclusion

Les algorithmes ne sont pas neutres : ils sont le miroir de notre société. Ils peuvent amplifier les injustices, mais aussi servir d'outils de lutte pour ceux qui les comprennent.

- algorithme

- réseaux sociaux

- big data

- machine learning

- biais cognitifs

- shadowban

- dsa

- éthique numérique